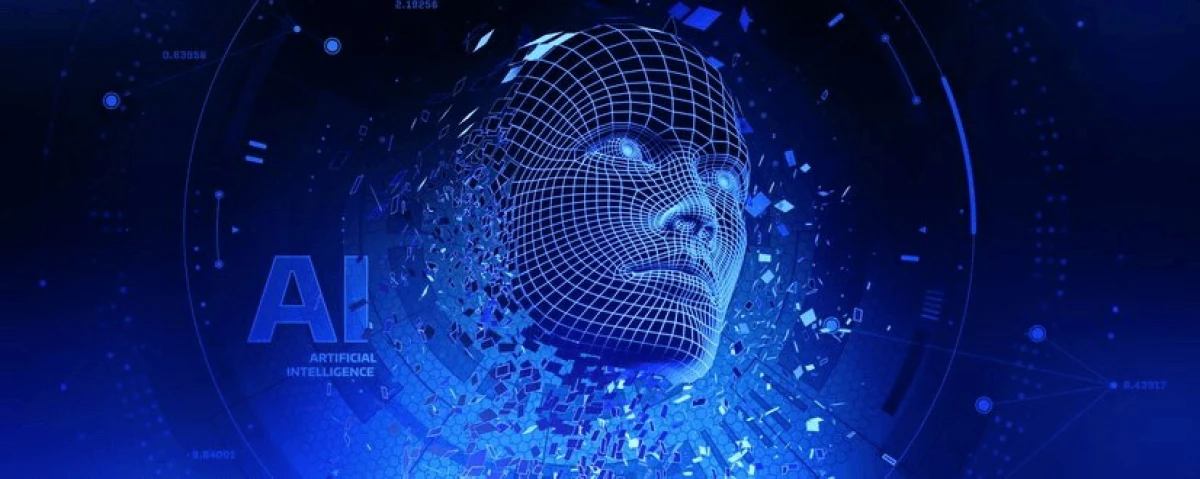

Новое исследование Университета Брауна показало, что языковые модели способны формировать представления о правдоподобии событий — несмотря на обучение на противоречивых данных.

Чат-боты обучаются на огромных объемах текста, где перемешаны факты, ошибки и абсурд, но новое исследование Университета Брауна показало, что языковые модели все же могут развить понимание, близкое к реальному миру.

Ученые проанализировали внутренние состояния моделей (GPT-2, Llama 3.2 и Gemma 2) при обработке обычных, маловероятных, невозможных и бессмысленных событий. В более крупных моделях (с объемом параметров более 2 млрд) сформировались отчетливые векторы для разных категорий правдоподобия, позволяющие с точностью около 85 % различать даже маловероятные и невозможные события.

Модели также отражали человеческую неуверенность в неоднозначных случаях: если среди людей было 50 % сторонников каждой категории, модели присваивали примерно 50-процентную вероятность каждому варианту. Это говорит о том, что ИИ не просто предсказывает следующее слово, а кодирует нечто вроде причинно-следственных связей реального мира.

Хотя работа не доказывает, что ИИ понимает мир так же, как люди, она предполагает, что внутри статистических механизмов формируется нечто более структурированное.

Это означает, что за внешней «угадайкой слов» скрываются более сложные процессы: ИИ постепенно выстраивает внутренние модели реальности, которые помогают ему ориентироваться в логике событий — даже если он не осознаёт их так, как человек, пишет bb.lv.